AI 모델의 숨겨진 비밀: 당신의 폰에서 더 강력한 AI를 만날 날이 올까요?

Published Mar 29, 2026

요즘 인공지능이 없는 삶은 상상하기 어렵습니다. 스마트폰으로 질문하고, 이미지를 생성하며, 심지어 복잡한 문서를 요약하는 등 AI는 우리 일상 깊숙이 들어와 있죠. 그런데 혹시 이런 생각 해보셨나요? ‘왜 AI 모델은 이렇게 느리거나, 왜 항상 클라우드에 연결되어야 할까?’ 솔직히 말해서, 일반 사용자의 입장에서 AI 모델의 속도나 접근성은 때때로 불편함을 주기도 합니다. 마치 고급 스포츠카를 샀는데, 연료가 너무 비싸서 마음껏 달릴 수 없는 상황과 비슷하다고 할까요? 이 모든 문제의 중심에는 바로 메모리라는 거대한 장벽이 존재합니다.

대규모 언어 모델(LLM) 같은 생성형 AI 모델들은 엄청난 양의 데이터를 처리하고 저장해야 하기에 막대한 양의 메모리가 필요합니다. 당장 고성능 AI 칩과 함께 엄청난 양의 RAM이 없으면, 제대로 된 AI를 구동하기 어렵습니다. 이게 바로 지금 우리가 체감하는 AI 서비스의 딜레이나, 내 손 안의 기기에서 강력한 AI를 온전히 경험하기 어려운 이유 중 하나입니다. 그런데 최근 구글 리서치(Google Research)에서 이 메모리 병목 현상을 획기적으로 해결할 수 있는 새로운 압축 알고리즘, **터보퀀트(TurboQuant)**를 공개했습니다. 이 기술은 LLM의 메모리 점유율을 대폭 줄이면서도 속도와 정확도를 유지한다는 점에서 정말 놀랍습니다.

AI 모델의 ‘컨닝 페이퍼’를 줄이다: 키-밸류 캐시와 터보퀀트

AI 모델이 정보를 처리하는 방식은 우리가 생각하는 것보다 훨씬 복잡합니다. 특히 LLM은 방대한 텍스트를 분석하고 생성하는 과정에서, 이전에 처리했던 중요한 정보들을 마치 ‘디지털 컨닝 페이퍼’처럼 저장해둡니다. 구글은 이것을 **키-밸류 캐시(key-value cache)**라고 비유했죠. 이 캐시는 모델이 특정 정보를 다시 계산할 필요 없이 빠르게 참조할 수 있도록 돕습니다. 왜냐하면 LLM은 사실상 어떤 것도 ‘알고’ 있는 것이 아니라, 토큰화된 텍스트의 의미론적 유사성을 벡터를 통해 매핑함으로써 ‘아는 척’을 하는 것이기 때문입니다. 두 벡터가 비슷하다면, 그것은 개념적으로 유사하다는 뜻이죠.

문제는 이 벡터들입니다. 이미지의 픽셀이나 대규모 데이터셋처럼 복잡한 정보를 묘사하는 고차원 벡터는 수백, 심지어 수천 개의 임베딩(embedding)을 가질 수 있습니다. 당연히 이 벡터들은 엄청난 메모리를 차지하고, 키-밸류 캐시의 크기를 부풀려 성능을 저하시키는 병목 현상을 일으킵니다. 이를 해결하기 위해 개발자들은 보통 양자화(quantization) 기술을 사용합니다. 모델을 더 낮은 정밀도로 실행하여 크기를 줄이는 방식이죠. 하지만 안타깝게도, 이 방법은 결과물의 품질을 떨어뜨리는 치명적인 단점이 있었습니다. 토큰 예측의 정확도가 낮아지는 것이죠. 성능은 빨라지지만, AI가 엉뚱한 답을 내놓을 가능성이 높아진다는 뜻입니다.

하지만 터보퀀트는 다릅니다. 구글의 초기 테스트 결과는 이 알고리즘이 일부 테스트에서 메모리 사용량을 6배 감소시키고 성능을 8배 향상시키면서도 품질 저하가 전혀 없었다고 보고합니다. 정말 혁신적이지 않나요? 기존의 양자화 기술의 단점을 완벽하게 보완한 것이죠. 그렇다면 터보퀀트가 어떻게 이런 마법 같은 일을 해낼 수 있었을까요?

벡터를 원형 좌표로, 오류는 비트로: 터보퀀트의 작동 방식

터보퀀트 알고리즘은 크게 두 단계의 과정을 거쳐 높은 품질의 압축을 달성합니다.

-

폴라퀀트(PolarQuant): 벡터를 극좌표계로 변환

- 일반적으로 AI 모델의 벡터는 표준 XYZ 좌표를 사용하여 인코딩됩니다. 예를 들어, “동쪽으로 3블록, 북쪽으로 4블록 가세요”와 같은 방식이죠.

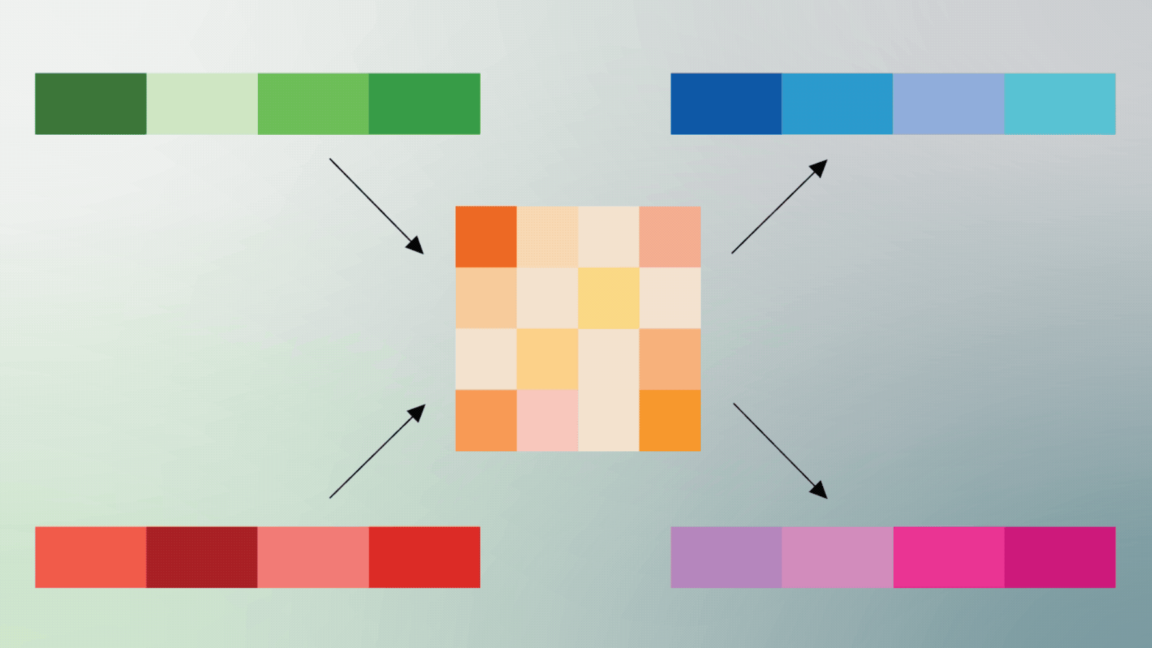

- 하지만 폴라퀀트는 이 벡터들을 직교 좌표계 내의 극좌표로 변환합니다. 이 원형 격자 위에서 벡터는 단 두 가지 정보로 축소됩니다: **반지름(데이터의 핵심 강도)**과 방향(데이터의 의미).

- 구글은 이를 “37도 방향으로 5블록 가세요”라고 비유했습니다. 이 방식은 훨씬 적은 공간을 차지하며, 시스템이 값비싼 데이터 정규화 단계를 수행할 필요가 없어 메모리를 절약합니다. 데이터의 본질적인 의미를 잃지 않으면서도 정보를 효율적으로 표현하는 기발한 아이디어입니다.

-

퀀타이즈드 존슨-린덴스트라우스 (Quantized Johnson-Lindenstrauss, QJL): 잔여 오류 보정

- 폴라퀀트가 대부분의 압축을 수행하지만, 이 과정에서 미세한 잔여 오류가 발생할 수 있습니다.

- QJL은 이 거친 부분을 다듬는 역할을 합니다. 이 기술은 모델에 1비트 오류 수정 레이어를 적용하여, 각 벡터를 단일 비트(+1 또는 -1)로 줄이면서도 관계를 설명하는 필수 벡터 데이터를 보존합니다.

- 그 결과는 더욱 정확한 **어텐션 스코어(attention score)**로 이어집니다. 어텐션 스코어는 신경망이 어떤 데이터가 중요한지 결정하는 근본적인 과정인데, 이 정확도가 유지된다는 것은 모델의 추론 능력에 전혀 손상이 없다는 것을 의미합니다.

이 모든 복잡한 수학적 과정이 과연 제대로 작동할까요? 구글은 Gemma와 Mistral 같은 오픈 모델을 사용하여 다양한 장문 맥락 벤치마크에 터보퀀트를 적용했다고 밝혔습니다. 놀랍게도, 터보퀀트는 모든 테스트에서 완벽한 결과를 보여주면서 키-밸류 캐시의 메모리 사용량을 6배 줄였습니다. 심지어 추가 훈련 없이 캐시를 3비트로 양자화할 수 있어 기존 모델에도 쉽게 적용 가능하다는 점은 큰 장점입니다. 엔비디아 H100 가속기에서 4비트 터보퀀트로 어텐션 스코어를 계산하는 속도는 32비트 비양자화 키에 비해 8배나 빨랐다고 하니, 속도와 효율성 면에서 타의 추종을 불허한다고 할 수 있습니다.

개인적인 분석: 터보퀀트가 바꿀 AI의 미래

이 부분에서 주목할 점은, 터보퀀트가 단순히 ‘AI 모델을 싸게 만드는 기술’을 넘어선다는 것입니다. 물론 메모리 사용량을 줄여 모델 운영 비용을 낮추는 효과는 분명합니다. 하지만 개인적으로는, 이 기술이 더욱 복잡하고 강력한 AI 모델의 등장을 촉진할 가능성이 높다고 생각합니다. 확보된 여유 메모리를 활용하여 모델의 파라미터 수를 늘리거나, 더 깊은 레이어를 추가하여 기존에는 구현하기 어려웠던 복잡한 추론 능력을 갖춘 AI를 만들 수 있게 되는 것이죠. 비용 절감과 성능 향상, 두 마리 토끼를 동시에 잡을 수 있는 게임 체인저가 될 수 있습니다.

특히 모바일 AI 분야에서 터보퀀트의 영향력은 매우 클 것으로 예상됩니다. 스마트폰의 하드웨어 한계는 AI 모델을 클라우드로 보내 처리해야 하는 주된 이유였습니다. 하지만 터보퀀트와 같은 압축 기술은 이러한 한계를 극복하고, 온디바이스(On-device) AI의 품질을 획기적으로 개선할 수 있습니다. 클라우드와의 통신 없이 스마트폰 자체에서 복잡한 AI 작업을 수행할 수 있다면, 응답 속도는 훨씬 빨라지고 데이터 프라이버시도 강화될 것입니다. 상상해보세요. 내 스마트폰이 항상 클라우드에 의존하지 않고도 실시간으로 더 똑똑하게 나를 돕는 미래를요. 사실 이건 사용자 경험을 한 단계 진화시키는 핵심 기술이 될 것입니다.

터보퀀트는 아직 초기 단계의 결과물이지만, AI 모델의 효율성과 접근성을 혁신적으로 개선할 잠재력을 지니고 있습니다. 값비싼 RAM과 고성능 하드웨어의 장벽을 낮추고, 더 많은 사람이 AI의 혜택을 누릴 수 있도록 돕는 중요한 전환점이 될 것입니다. 앞으로 터보퀀트가 실제로 어떤 서비스와 제품에 적용되어 우리 일상에 스며들지, 그 귀추가 정말 기대됩니다.

출처

- 원문 제목: Google’s TurboQuant AI-compression algorithm can reduce LLM memory usage by 6x

- 출처: Artificial Intelligence - Ars Technica

- 원문 기사 보러가기